Schüler nutzen KI längst. Nicht irgendwann, nicht vielleicht – jetzt. Die Frage ist nicht mehr, ob ChatGPT im Klassenzimmer angekommen ist, sondern was dort eigentlich passiert, wenn niemand hinschaut.

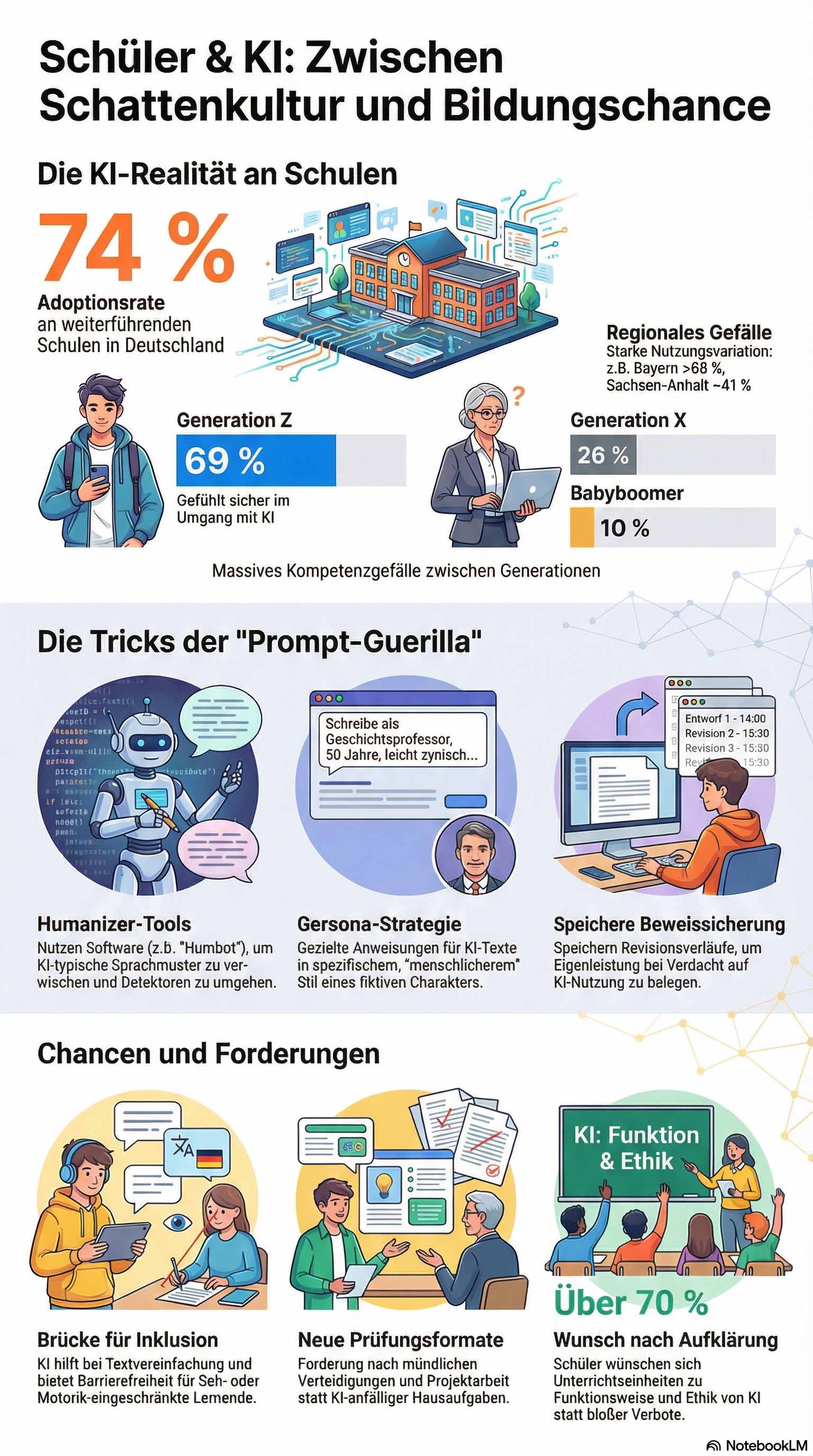

Rund 74 % der weiterführenden Schulen in Deutschland setzen KI-Anwendungen im Unterricht ein (Stand 02/2026). Das klingt nach Fortschritt. Die Realität ist komplizierter. Denn während Bildungspolitiker noch an Leitfäden, Datenschutzkonzepten und Trallala feilen, haben Schüler ihre eigenen Methoden entwickelt – eine Art Schatten-Pädagogik, die in keinem Lehrplan steht.

Inhaltsverzeichnis

Was die Zahlen verraten

Die Nutzung verteilt sich ungleich. In Bayern, Nordrhein-Westfalen und Baden-Württemberg liegt die Adoptionsrate bei über 68 % pro Schule, in Sachsen-Anhalt oder Thüringen bei etwa 41 %. Das hat nicht nur mit Technik zu tun, sondern auch mit Fortbildungsangeboten und Innovationskultur.

Besonders auffällig ist das Generationengefälle. Laut einer FOM-Studie fühlen sich 69 % der Generation Z im Umgang mit KI sicher. Bei der Generation X sind es 26 %, bei den Babyboomern gerade noch 10 %. Für den Schulalltag bedeutet das: Schüler gehen unbefangener mit KI um als ihre Lehrkräfte – was nicht heißt, dass sie sie besser verstehen. Der vermeintliche Kompetenzvorsprung ist oft Vertrautheit mit der Oberfläche. Wer mit einer Technologie aufwächst, hat weniger Berührungsangst, aber nicht automatisch mehr Durchblick. Wie ein Sprachmodell funktioniert, was ein Token ist oder warum Halluzinationen entstehen, wissen die wenigsten.

Auf der anderen Seite zeigt sich die Lehrerschaft als besonders zurückhaltende Berufsgruppe, wenn es um neue Technologie geht. Selbst beim E-Book, das Schulbuchverlage längst anbieten, bleibt die Nachfrage gering – gedrucktes Papier hat im Lehrerzimmer eine treue Fangemeinde. Das hat auch mit dem vorherrschenden Milieu zu tun: Unter Lehrkräften dominiert ein akademisch-idealistisches Selbstverständnis, das Bildung vor allem als zwischenmenschlichen Prozess begreift. Technologie wird dort schnell mit Entfremdung, Konzernmacht und pädagogischem Kontrollverlust assoziiert. Wer sich selbst als progressiv versteht, ist ausgerechnet beim technologischen Fortschritt erstaunlich konservativ.

Dabei ginge es auch anders. Kurd Laßwitz, Mathematik- und Physiklehrer am Gymnasium Ernestinum in Gotha, war Ende des 19. Jahrhunderts bei seinen Schülern legendär – nicht obwohl, sondern weil er sich für die Zukunft begeisterte. Nebenbei begründete er mit Romanen wie »Auf zwei Planeten« (1897) die deutsche Science-Fiction. Ein Pädagoge, der Technik nicht als Bedrohung sah, sondern als Erweiterung menschlicher Möglichkeiten. Ein völlig anderer Typ, der heute undenkbar scheint. 130 Jahre später diskutieren Kollegien darüber, ob man Schülern einen Chatbot erlauben darf. Der Kontrast ist ernüchternd.

Nur jede vierte Lehrkraft gibt an, sich im Umgang mit KI-Tools sicher zu fühlen – obwohl 81 % sich eine verpflichtende Verankerung von KI in der Ausbildung wünschen. Die Bereitschaft ist da, die Praxis hinkt hinterher.

Humanizer: Das technologische Wettrüsten

Viele Schulen setzen auf Detektionssoftware, um KI-generierte Texte aufzuspüren. Die Antwort der Schüler: sogenannte Humanizer. Das sind Tools wie Undetectable AI, Humbot oder BypassGPT, die darauf spezialisiert sind, die statistischen Signaturen von KI-Texten zu verwischen.

KI-Detektoren analysieren Muster – übermäßig perfekte Grammatik, gleichförmige Satzlängen, vorhersehbare Wortwahl. Fachbegriffe dafür sind Perplexität und Burstiness. Humanizer-Tools setzen genau dort an. Sie variieren Satzlängen, entfernen typische KI-Indikatoren wie »darüber hinaus« oder »zusammenfassend lässt sich sagen« und fügen teils absichtlich leichte Unregelmäßigkeiten ein.

In Schülerforen werden Detektoren oft mit Skepsis betrachtet. Der Vorwurf: Sie seien unzuverlässig und riskierten Falschbeschuldigungen. Wer einen eigenen Text »zu sauber« schreibe, könne fälschlich als KI-Nutzer markiert werden. Der Humanizer wird dann zur Schutzmaßnahme – eine paradoxe Situation.

Die Tricks der Prompt-Guerilla

Neben kostenpflichtigen Tools kursieren in Foren wie Reddit zahlreiche manuelle Techniken, die erstaunlich viel über das Verständnis der Schüler für Sprachmodelle verraten.

Die Persona-Strategie: Statt die KI einfach einen Aufsatz schreiben zu lassen, weisen Schüler sie an, als konkreter Charakter zu schreiben – zum Beispiel als »Bob, ein entspannter 30-jähriger Autor mit einfacher Sprache«. Durch die Vorgabe eines individuellen Stils weicht die KI von ihren standardisierten Wortfolgen ab, was die Erkennung erschwert.

Lokale Bezüge und Memes: Menschliches Schreiben lebt von Inkonsistenzen und Kontextwissen. Schüler reichern KI-Entwürfe mit Hinweisen auf konkrete Lehrer, lokale Ereignisse oder aktuelle TikTok-Trends an – Informationen, die kein Sprachmodell in seinen Trainingsdaten hat.

Bewusste Fehler: Ein paar unkonventionelle Kommasetzungen, ein überflüssiger Halbsatz, eine ungewöhnliche Kursivierung – das Ziel ist, den Eindruck eines organisch gewachsenen Textes zu erzeugen.

Prozessdokumentation: Der vielleicht cleverste Ansatz ist die proaktive Beweissicherung. Schüler bewahren ihre Revisionsverläufe in Google Docs oder Word auf. Wer einen unordentlichen Erstentwurf vorzeigen kann, hat den besten Beleg für Eigenleistung – egal, ob die KI beim Aufräumen geholfen hat.

Wer tiefer einsteigen will: 41 konkrete Wege, wie Schüler KI in der Schule nutzen.

Neue Freiheit oder höherer Druck?

Die Bewertung fällt zwiegespalten aus. Einerseits: KI-Tools reduzieren die Last mechanischer Texterstellung und ermöglichen es Schülern, sich auf Konzepte und Inhalte zu konzentrieren. In Sachsen berichten Lehrkräfte, dass der KI-Assistent »KAI« Übungsmaterialien auf verschiedenen Niveaustufen in Sekunden generieren kann – eine enorme Arbeitserleichterung.

Andererseits droht eine Eskalationsspirale. Wenn KI-gestützte »perfekte« Texte zur Normalität werden, steigen die Erwartungen. Was früher als exzellent galt, wird zum Standard. Dazu kommt der psychische Druck, die eigene Urheberschaft permanent beweisen zu müssen. In Foren ist vom »Generalverdacht« die Rede – kein angenehmes Lernklima.

Und dann ist da der Digital Divide. Eine Untersuchung des BMBF zeigt: Schüler aus privilegierten Verhältnissen haben Zugriff auf kostenpflichtige Premium-Versionen mit besserem Datenschutz. Sozial benachteiligte Schüler nutzen kostenlose Basismodelle – und bezahlen faktisch mit ihren persönlichen Daten. Das Versprechen, KI mache Bildung gerechter, verkehrt sich hier ins Gegenteil.

KI als Brücke für Inklusion und Sprachförderung

Eines der überzeugendsten Einsatzgebiete ist die Überwindung von Sprachbarrieren. In Sachsen etwa sollen migrantische Schüler oft bereits nach zwei Jahren in Regelklassen wechseln – unabhängig vom tatsächlichen Sprachniveau. KI kann hier konkret helfen.

Komplexe Fachtexte in Geschichte oder Biologie lassen sich in einfache Sprache transformieren, ohne den Kern zu verfälschen. Echtzeit-Übersetzung ermöglicht bilinguale Materialien, sodass Schüler ihre Herkunftssprachen aktiv einbringen können. KI-Chatbots fungieren als geduldige Tutoren für Grammatikübungen und Dialogsimulationen.

Auch jenseits der Sprachbarriere wirkt KI inklusiv. 42 % der inklusiven Schulen setzen bereits KI-Software ein. Für sehbeeinträchtigte Schüler beschreiben Modelle wie GPT-4 Bilder und Grafiken detailliert. Text-to-Speech-Funktionen helfen bei Leseschwierigkeiten. Spracheingabe ermöglicht Schülern mit motorischen Einschränkungen, ihre Gedanken barrierefrei zu verschriftlichen. Mehr dazu beim RPI Loccum.

Die Schule könnte durch KI ein besserer Ort werden – gerade in Zeiten des Lehrermangels, in denen individuelle Betreuung oft schlicht nicht leistbar ist.

Was sich Schüler wünschen

Die Schülerperspektive ist überraschend nüchtern. Wer in Foren und Umfragen hineinliest, findet keine Forderung nach weniger Regeln, sondern nach ehrlicheren.

Über 70 % der Schüler wollen Unterrichtseinheiten darüber, wie KI funktioniert und wo die Grenzen liegen. Sie haben verstanden, dass der kompetente Umgang mit KI eine Schlüsselqualifikation wird – und dass bloßes Verbieten diese Kompetenz nicht fördert. Das ist keine naive Position. Es ist die realistischere als das, was viele Kollegien derzeit praktizieren.

Beim Prüfungswesen wird es konkreter. In Schülerforen wird über eine Abkehr von Formaten diskutiert, die KI in Sekunden erledigen kann. Stattdessen: mündliche Verteidigung, bei der Schüler ihren Lösungsweg erklären müssen. Projektorientiertes Arbeiten, bei dem KI als Werkzeug dient, aber nicht als alleiniger Urheber. Transferleistungen, die aktuelles Kontextwissen erfordern, das über das statische Wissen der Modelle hinausgeht.

Im Kern steht eine einfache Forderung: Bewertet nicht die algorithmische Glätte eines Textes, sondern seine inhaltliche Tiefe und menschliche Originalität.

Das ist vermutlich der klügste Satz, den Schüler derzeit zur KI-Debatte beitragen.