Lange Prompts können durchaus tausend oder mehr Zeichen enthalten. In KI-Foren kursieren Prompts mit über 3.000 Zeilen – komplette Regelwerke mit Rollenbeschreibungen, Dutzenden Beispielen, Formatvorgaben, Ausnahmen von den Ausnahmen und einer Logik, die an Steuerrecht erinnert. Normal ist das nicht, ich nenne so etwas einen Promptpalast.

Die Idee dahinter leuchtend aber ein. Statt die KI in zehn Einzelschritten zum Ziel zu führen, packt man alles in eine einzige Eingabe. Rolle, Kontext, Regeln, Beispiele, Aufgabe – das volle Programm. Ein Mini-Programm in natürlicher Sprache. Und tatsächlich funktioniert das. Manchmal sogar erstaunlich gut.

Aber manchmal eben auch nicht. Tja … Schauen wir uns das näher an.

Inhaltsverzeichnis

Prompt vs. Kontext: Ein wichtiger Unterschied

Bevor es losgeht, eine Klarstellung. Das Kontextfenster ist der gesamte Raum, den eine KI gleichzeitig sehen kann – deine Frage, hochgeladene Dokumente, die bisherige Konversation, alles zusammen. Wer ein 800-Seiten-Buch hochlädt und »Fasse das zusammen« schreibt, nutzt ein riesiges Kontextfenster. Der Prompt selbst sind sechs Wörter.

Der Promptpalast ist etwas anderes. Er ist die Anweisung selbst – lang, durchstrukturiert, mit Regeln, Rollen und Beispielen. Man kann einen riesigen Prompt haben, ohne ein einziges Dokument hochzuladen. Die Komplexität steckt in der Instruktion, nicht im Material.

Was können lange Prompts?

Der Hauptvorteil: weniger Iterationen. Statt zehnmal nachzusteuern, definiert man einmal, was man will – und wie genau man es will. Das spart Zeit, wenn der Prompt einmal steht.

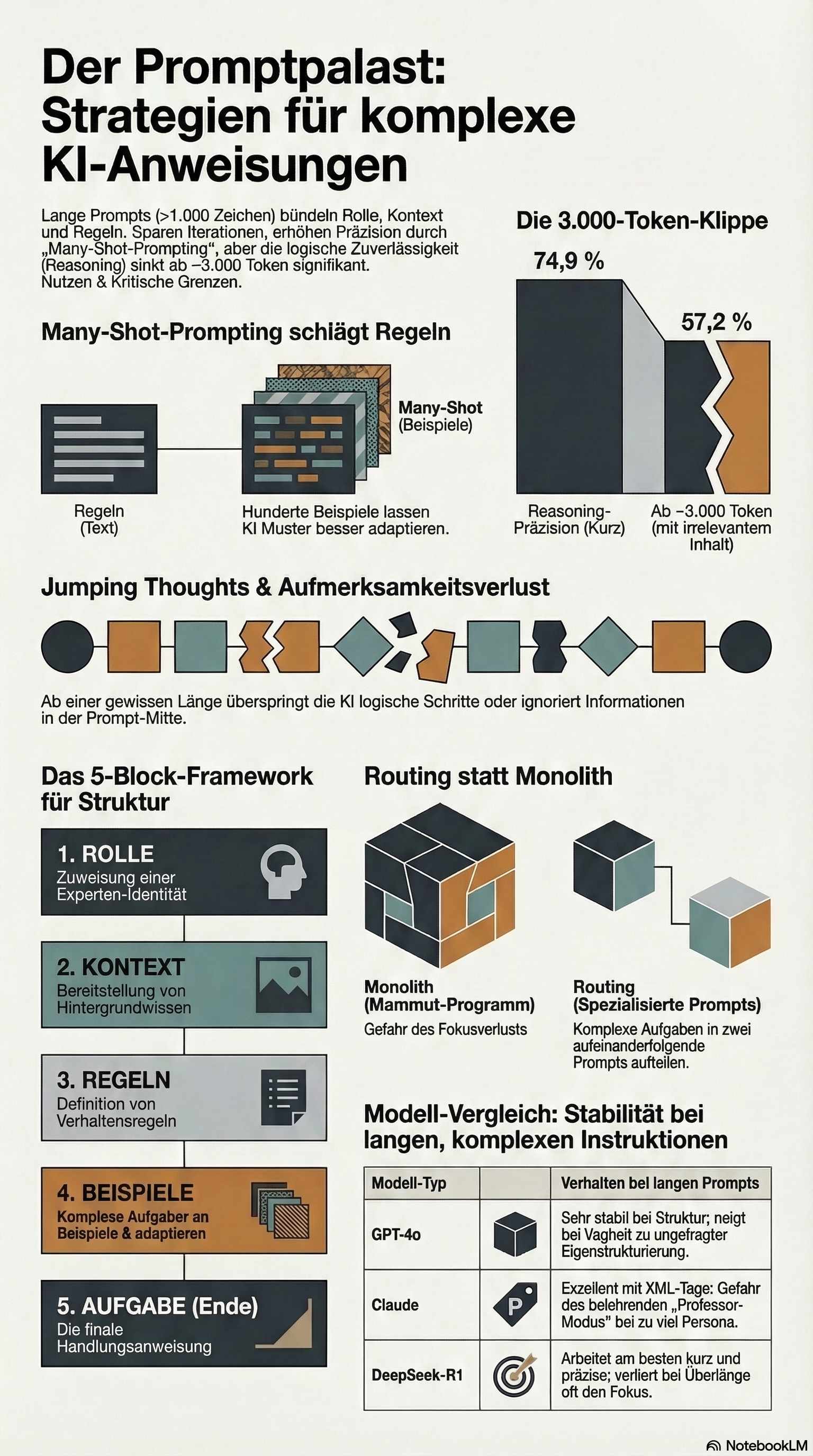

Hunderte Beispiele statt Regeln. Aktuelle Studien, unter anderem von Anthropic, zeigen: Je mehr Beispiele ein Prompt enthält, desto besser adaptiert das Modell an komplexe Muster. Many-Shot-Prompting mit hunderten Beispielen kann in manchen Fällen sogar ein teures Fine-Tuning ersetzen. Die KI lernt durch Anschauung, nicht durch Erklärung. Kennt jeder aus der Schule.

Persona-Steuerung in der Tiefe. Wer die KI nicht nur als Assistenten nutzt, sondern als Kritiker, Lektor, Sparringspartner oder Simulationsumgebung, braucht Platz für die Rollenbeschreibung. »Du bist ein erfahrener Backend-Ingenieur mit 15 Jahren Erfahrung« reicht für einfache Aufgaben. Für komplexe braucht es mehr: Welche Frameworks bevorzugt diese Person? Wie argumentiert sie? Wo ist sie skeptisch?

Wiederverwendbare Frameworks. Ein gut gebauter Mega-Prompt ist wie eine Vorlage. Etwa 60 % – Rolle, Regeln, Struktur – bleiben gleich, nur die eigentliche Aufgabe wechselt. In der Praxis entstehen daraus Bibliotheken von Prompts für wiederkehrende Aufgaben: Lektorat, Code-Review, Datenanalyse, Übersetzung.

Ganze Systeme aus einem Guss. Entwickler berichten von Prompts, die komplette Anwendungsarchitekturen beschreiben – Dateistruktur, Abhängigkeiten, Geschäftslogik, Testfälle. Die KI baut daraus ein funktionierendes System. Nicht immer perfekt, aber als Startpunkt brauchbar. Vibe Coding lebt davon.

Die 3.000-Token-Klippe

Hier wird es unangenehm. Untersuchungen zeigen, dass die Reasoning-Fähigkeiten vieler Sprachmodelle bereits bei etwa 3.000 Token deutlich abfallen. Das Modell kann den Text noch lesen, aber es beginnt, logische Schritte zu überspringen – ein Phänomen, das Forscher als »Jumping Thoughts« bezeichnen.

3.000 Token. Das sind ungefähr 2.000 Wörter oder vier Seiten. Der Promptpalast stößt also nicht erst bei einer Million Token an seine Grenzen, sondern sehr viel früher. Nicht weil die KI den Text nicht verarbeiten kann, sondern weil ihre Aufmerksamkeit endlich ist.

Jedes Token verbraucht einen Teil des Aufmerksamkeitsbudgets. Je mehr Text, desto dünner wird die Aufmerksamkeit verteilt. Ab einem bestimmten Punkt kann die KI nicht mehr alles gleichzeitig im Blick behalten. Sie priorisiert – und übersieht Details. Besonders betroffen: Informationen in der Mitte des Prompts.

In Tests sank die Reasoning-Präzision bei hohem Anteil irrelevanter Inhalte im Prompt von 74,9 % auf 57,2 %. Das ist kein Randeffekt. Das ist ein Qualitätsverlust von fast einem Viertel.

Nicht jedes Modell reagiert gleich

Wie gut eine KI mit riesigen Prompts umgeht, hängt stark vom Modell ab. Die Unterschiede sind größer, als man denkt.

GPT-4o und GPT-5 sind bei strukturierten Mega-Prompts sehr stabil. Bei vagen, schlecht organisierten langen Texten neigen sie allerdings dazu, zu überkompensieren – sie fügen Struktur hinzu, die niemand verlangt hat.

Claude reagiert besonders gut auf XML-Tags und hierarchische Strukturen innerhalb langer Prompts. Bei zu ausführlichen Persona-Instruktionen kann Claude allerdings in einen dozierenden Tonfall abrutschen. In Foren heißt das »Professor Dad Mode«.

DeepSeek-R1 ist spröde. Das Modell arbeitet am besten mit kurzen, präzisen Prompts. Bei zu langen Instruktionen kann der interne Denkprozess vom eigentlichen Ziel abweichen – die KI denkt sich dann in eine Richtung, die niemand wollte.

Open-Source-Modelle wie Llama 4 profitieren stark von Many-Shot-Beispielen, scheitern aber oft an komplexen Formatvorgaben. Sie brauchen eine striktere Struktur als die API-Modelle der großen Anbieter.

Wo der Promptpalast einstürzt

Die Risiken sind nicht theoretisch. Sie zeigen sich im Alltag, bei jedem größeren Prompt-Projekt.

Fragilität. Mega-Prompts sind monolithisch. Eine kleine Änderung an einer Regel kann das gesamte Verhalten unvorhersehbar verändern. Du passt eine Formatvorgabe an und plötzlich ignoriert die KI drei andere Regeln. Debugging wird zum Ratespiel.

Widersprüche. Je mehr Regeln, desto höher die Wahrscheinlichkeit, dass sich zwei davon beißen. »Schreibe kurz und prägnant« plus »Erwähne alle 50 Details« – das kann kein Modell sauber lösen. Es wird improvisieren. Und dabei halluzinieren.

Kosten und Latenz. Riesige Prompts kosten mehr, weil API-Anbieter pro Token abrechnen. Und sie dauern länger – bis zu 45 Sekunden pro Anfrage bei vollem Kontext. Wer den Prompt hundertmal am Tag abfeuert, merkt das auf der Rechnung.

Sycophancy. Bei sehr langen, detaillierten Prompts neigen manche Modelle dazu, dem Nutzer nach dem Mund zu reden. Die KI versucht, alle Regeln zu befolgen, und verliert dabei ihre kritische Distanz. Das Ergebnis klingt gut, ist aber inhaltlich schwach.

Das 5-Block-Framework

In Fachforen wie r/PromptEngineering hat sich eine Struktur durchgesetzt, die den Promptpalast handhabbar macht. Fünf Blöcke, klar getrennt:

1. Rolle. Wer ist die KI in diesem Gespräch? Erfahrener Lektor, skeptischer Forscher, pragmatischer Entwickler. Kurz und präzise, nicht drei Absätze Lebensgeschichte.

2. Kontext. Was muss die KI wissen, um die Aufgabe zu verstehen? Hintergrund, Zielgruppe, bisherige Entscheidungen. Nur was relevant ist.

3. Regeln und Beschränkungen. Was soll die KI tun, was nicht? Formatvorgaben, Tonfall, Verbote. Widersprüche hier kosten Qualität.

4. Beispiele. Zwei bis fünf gute Beispiele für das gewünschte Ergebnis. Oder hundert, wenn es um Muster geht. Beispiele wirken stärker als Regeln.

5. Aufgabe. Was genau soll jetzt passieren? Der eigentliche Auftrag. Am Ende des Prompts, weil die KI das Letzte am besten gewichtet.

Etwa 60% dieses Gerüsts – Rolle, Kontext, Regeln – bleiben bei wiederkehrenden Aufgaben gleich. Nur Block 4 und 5 ändern sich. Das macht den Mega-Prompt zum wiederverwendbaren Werkzeug statt zum Einmalprodukt.

Routing statt Monolith

Die vielleicht wichtigste Erkenntnis aus der Praxis: Der beste Mega-Prompt ist oft gar keiner.

Fortgeschrittene Systeme setzen stattdessen auf Routing. Ein kleiner, spezialisierter Prompt klassifiziert zuerst, worum es geht. Dann leitet er die Anfrage an einen zweiten, ebenfalls spezialisierten Prompt weiter. Statt eines Universalgenies, das alles gleichzeitig können muss, arbeiten mehrere Spezialisten hintereinander.

Das reduziert die Komplexität pro Schritt, senkt das Halluzinationsrisiko und macht das System debuggbar. Wenn etwas schiefgeht, weiß man, welcher Prompt verantwortlich ist. Beim Monolithen ist das Glückssache.

Für den normalen Nutzer heißt das: Lieber zwei aufeinanderfolgende Prompts als einen, der alles auf einmal versucht. Erst die Daten aufbereiten lassen, dann analysieren. Erst den Entwurf, dann die Überarbeitung. Die KI macht jeden Einzelschritt besser als den Gesamtprozess.

9 Regeln für den langen Prompt

Wer trotzdem einen großen Prompt bauen will oder muss – und es gibt gute Gründe dafür – sollte diese Punkte beachten.

Beispiele wirken stärker als Regeln. Zehn gute Beispiele erklären mehr als zwei Seiten Anweisungstext. Die KI lernt durch Muster, nicht durch Paragraphen.

Struktur ist Pflicht. XML-Tags, klare Blöcke, konsistente Bezeichnungen. Ohne Struktur wird jeder Prompt ab 500 Wörtern zum Glücksspiel.

Aufgabe ans Ende. Die KI gewichtet das Letzte am stärksten. Der eigentliche Auftrag gehört immer an den Schluss.

Widersprüche eliminieren. Jede Regel gegen jede andere prüfen. Widersprüche sind der häufigste Grund für schlechte Ergebnisse bei Mega-Prompts.

Irrelevantes streichen. Jedes Token, das nichts beiträgt, verdünnt die Aufmerksamkeit für den Rest. Weniger ist oft mehr.

Das Modell kennen. Claude mag XML-Tags, DeepSeek mag kurze Prompts, GPT ist tolerant bei Struktur. Wer den Prompt ans Modell anpasst, bekommt bessere Ergebnisse.

Testen, nicht hoffen. Einen Mega-Prompt mit fünf verschiedenen Eingaben testen, bevor man ihn in den Produktivbetrieb nimmt. Fragilität zeigt sich erst im Einsatz.

Modular denken. Wenn möglich, den Prompt in wiederverwendbare Blöcke zerlegen. Das macht Änderungen beherrschbar und Fehler auffindbar.

Wissen, wann es reicht. Ein präziser Prompt mit 500 Wörtern und zwei guten Beispielen schlägt einen 10.000-Wörter-Datendschungel. Der Aufwand muss zum Ergebnis passen.

Wann sich der Aufwand lohnt

Lange Prompts sind kein Werkzeug für jede Gelegenheit. Für eine schnelle Frage, eine Zusammenfassung, eine Textkorrektur – dafür braucht man keine tausend Wörter Anweisung. Da reichen drei Sätze.

Er lohnt sich, wenn die Aufgabe wiederkehrt und die Qualität stimmen muss. Wenn man ein Lektorat-Framework baut, das hunderte Texte nach denselben Kriterien prüft. Wenn man ein Coding-Setup erstellt, das eine bestimmte Architektur konsistent einhält. Wenn man der KI einen Denkstil beibringen will, der über »sei kritisch« hinausgeht.

In all diesen Fällen amortisiert sich der Bauaufwand. Der Prompt wird zum Asset, nicht zum Einwegprodukt.

Für alles andere gilt: Der beste Prompt ist meistens der kürzeste, der noch funktioniert.