Die meisten Menschen tippen eine Frage in ChatGPT, lesen die Antwort und halten das für Recherche. Das ist ungefähr so, als würde man den Klappentext eines Buches lesen und behaupten, man kenne den Inhalt.

Deep Research funktioniert anders. Es ist kein einzelner Prompt, sondern ein Prozess – mehrstufig, iterativ und erstaunlich leistungsfähig, wenn man weiß, welche Hebel es gibt. Die großen KI-Anbieter haben dafür eigene Modi entwickelt: ChatGPT hat Deep Research, Claude bietet erweiterte Recherche, Gemini ebenfalls. Aber das Werkzeug allein macht noch keinen guten Rechercheur.

Hier erfährst du, wie du Deep Research systematisch einsetzt, welche Fehler du vermeiden solltest und warum das Ergebnis immer nur so gut ist wie dein Prozess.

Inhaltsverzeichnis

Was Deep Research von einer normalen Suche unterscheidet

Eine gewöhnliche Websuche beantwortet Faktenfragen. Wer die Hauptstadt von Moldawien wissen will, braucht keine zehn Sekunden. Deep Research beginnt dort, wo solche Antworten aufhören.

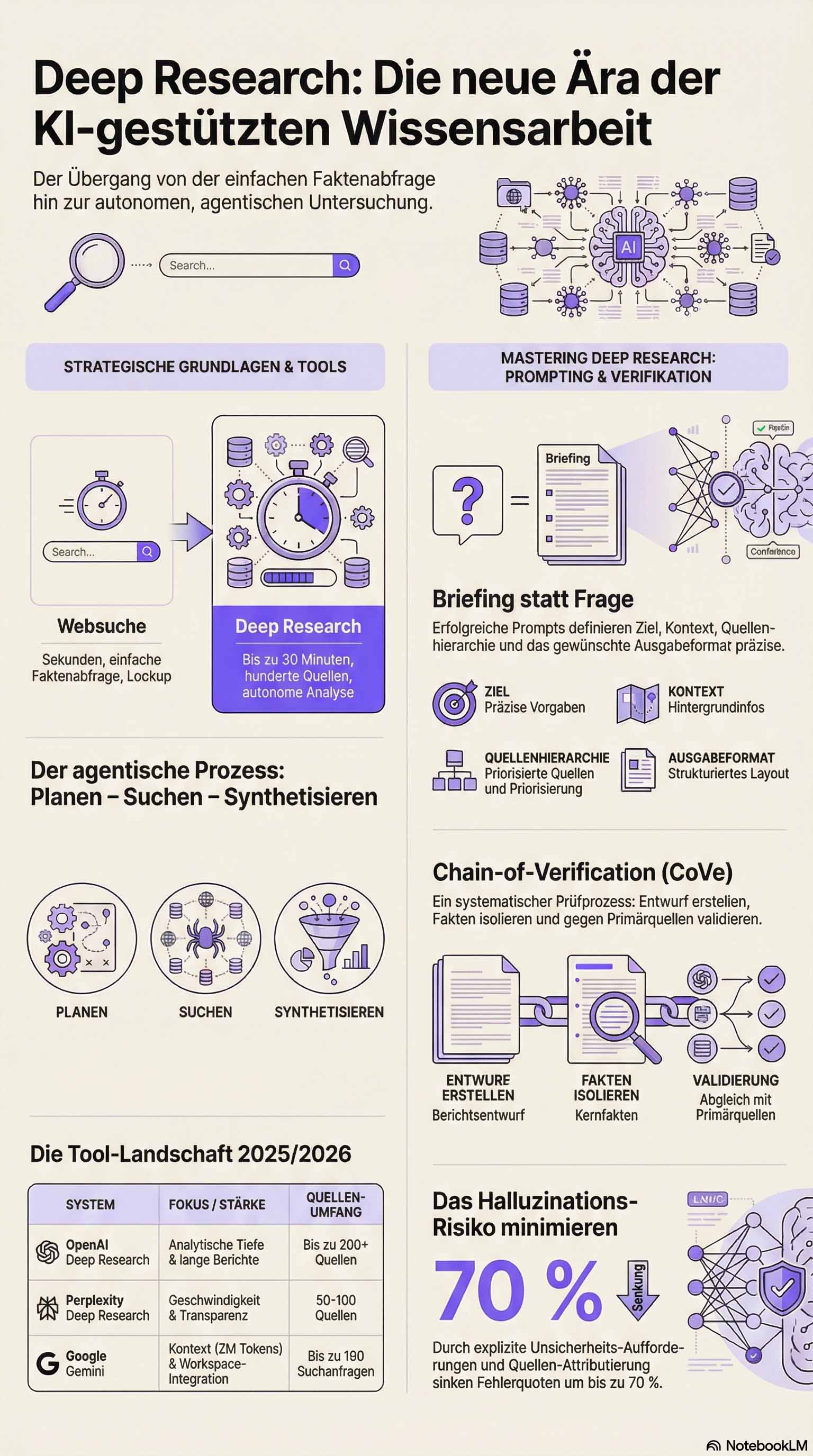

Der Unterschied liegt in der Tiefe und in der Methode. Statt einer einzelnen Abfrage startet das System einen autonomen Rechercheprozess: Es zerlegt deine Frage in Teilfragen, durchsucht dutzende bis hunderte Quellen, vergleicht Aussagen, erkennt Widersprüche und baut aus den Ergebnissen einen zusammenhängenden Bericht. Das dauert nicht Sekunden, sondern Minuten – bei manchen Systemen auch deutlich länger. Dafür bekommt man etwas, das einer echten Analyse nahekommt.

Typische Anwendungen sind Marktanalysen, Literaturrecherchen, Wettbewerbsvergleiche, Trendberichte oder die Aufarbeitung komplexer Sachverhalte, bei denen eine oberflächliche Antwort schlicht nicht reicht.

Wer kann es – und was kostet es?

Die Anbieter unterscheiden sich erheblich in Geschwindigkeit, Tiefe und Preis (Stand 02/2026):

OpenAI setzt auf analytische Tiefe. Das System nutzt mehrstufiges Reasoning, das zwischen 5 und 30 Minuten pro Abfrage beanspruchen kann, liefert dafür aber extrem ausführliche Berichte von oft mehr als 25 Seiten. Der Pro-Tier kostet 200 Dollar im Monat und richtet sich an Power-User.

Gemini ist schnell – oft unter fünf Minuten – und punktet mit einem riesigen Kontextfenster von bis zu zwei Millionen Token. Das bedeutet: Es kann ganze Dokumentensammlungen gleichzeitig verarbeiten. Für 20 Dollar im Monat ist es das beste Preis-Leistungs-Verhältnis, wenn es um Synthese großer Datenmengen geht.

Perplexity ist der Sprinter. Ergebnisse kommen in ein bis vier Minuten, strukturiert und mit Quellenangaben. Besonders nützlich: Man kann zwischen verschiedenen Modellen wechseln und die Suche auf akademische Paper, Finanzdaten oder Reddit-Threads eingrenzen. Ebenfalls 20 Dollar monatlich.

Grok von xAI erzielt Bestwerte in Mathematik, Programmierung und Naturwissenschaften und hat Zugriff auf Echtzeitdaten der Plattform X. Kostet 40 Dollar im Monat.

Claude von Anthropic hat keinen eigenen »Deep Research«-Modus, bietet aber seit 2025 eine erweiterte Recherche-Funktion, die funktional vergleichbar ist. In Tests fiel Claude durch eine besonders hohe Quellenbreite auf. Ein Alleinstellungsmerkmal ist die Integration mit Unternehmenssystemen über sogenannte MCP-Konnektoren – Claude kann dadurch nicht nur das Web durchsuchen, sondern auch interne Quellen wie Jira, Confluence oder Google Drive einbeziehen. Für Teams, die Recherche und interne Dokumentation zusammenbringen wollen, ist das ein relevanter Vorteil. Ebenfalls 20 Dollar monatlich.

Alle Angaben sind Momentaufnahmen. Preise, Modellversionen und Funktionsumfang ändern sich laufend.

Der Mythos vom perfekten Prompt

Der häufigste Ratschlag zu Deep Research lautet: Schreib ein möglichst präzises, detailliertes Briefing. Definiere Zielgruppe, Zeitrahmen, Quellenpräferenz, Berichtsstruktur. Je genauer der Prompt, desto besser das Ergebnis.

Das klingt einleuchtend. Und es ist auch nicht falsch – aber es ist nur die halbe Wahrheit.

In der Praxis zeigt sich etwas Überraschendes: Ein offener, explorativer Prompt liefert in der ersten Runde oft mehr verwertbares Material als ein durchstrukturiertes Briefing. Warum? Weil ein enger Prompt das System dazu bringt, genau das zu suchen, was du erwartest. Ein offener Prompt erlaubt dem System, Dinge zu finden, von denen du nicht wusstest, dass es sie gibt.

Ein konkretes Beispiel: Auf den Prompt »Recherchiere, wie man Deep Research am besten durchführt – suche in Foren, Blogs und Papers« lieferte eine KI unter anderem einen dokumentierten Vergleichstest, bei dem vier KI-Modelle anhand eines echten Vermisstenfalls getestet wurden. Dieses Material war extrem aufschlussreich, hätte aber in einem eng gefassten Briefing nie auftauchen können, weil niemand danach gefragt hätte.

Die Asymmetrie ist klar: Weglassen ist trivial, Nachrecherchieren kostet einen zweiten Durchlauf.

Zwei Runden statt einer

Die effektivste Strategie für Deep Research ist kein einzelner perfekter Prompt, sondern ein Zweischritt. Am besten lässt sich das an einem konkreten Beispiel zeigen – sagen wir, du willst einen Artikel über die Vier-Tage-Woche schreiben.

Runde 1 – Breit erkunden. Starte mit einem offenen Prompt, der die Richtung vorgibt, aber nicht einengt:

Recherchiere den aktuellen Stand zur Vier-Tage-Woche: wissenschaftliche Studien, Unternehmens-Pilotprojekte, Erfahrungsberichte, Kritik. Suche in Fachcommunities, Blogs und wissenschaftlichen Quellen. Lieber zu viel Material als zu wenig.Das ist bewusst offen. Du sagst nicht, welche Länder, welche Branchen, welchen Zeitraum. Du lässt dem System Raum, Dinge zu finden, nach denen du nicht gefragt hättest – vielleicht eine isländische Langzeitstudie, vielleicht ein gescheitertes Pilotprojekt in Japan.

Runde 2 – Gezielt vertiefen. Nachdem du den ersten Output gesichtet hast, weißt du, wo die Stärken und Lücken liegen. Jetzt formulierst du einen spezifischen Prompt:

Im ersten Durchlauf fehlten konkrete Produktivitätszahlen aus den britischen Pilotprojekten 2022–2024 und eine Übersicht der Gegenargumente von Arbeitgeberverbänden. Recherchiere gezielt: Wie hoch war der gemessene Produktivitätseffekt in den UK-Trials? Welche Branchen hatten die schlechtesten Ergebnisse? Was sagen BDA, BDI oder vergleichbare Verbände zur Vier-Tage-Woche? Bevorzuge Primärquellen.Dieser Zweischritt schlägt den Einzelprompt zuverlässig, weil er zwei Phasen abdeckt, die sich gegenseitig bedingen: Exploration (was gibt es überhaupt?) und Vertiefung (was brauche ich konkret?). Das entspricht dem Workflow, den Forscher im Alignment Forum als »Explore – Understand – Distill« beschreiben: erst breit abtasten, dann Hypothesen bilden, dann auf das Wesentliche verdichten.

Den Recherche-Plan prüfen, bevor es losgeht

Bevor Deep Research tatsächlich startet, zeigen ChatGPT und Gemini eine Zusammenfassung des geplanten Vorgehens an – welche Teilfragen untersucht werden, welche Quellen durchsucht werden sollen. Man hat die Gelegenheit, diesen Plan zu bearbeiten, bevor man auf »Starten« klickt.

Diesen Moment solltest du nutzen. Prüfe, ob die Teilfragen dein Thema tatsächlich abdecken oder ob das System in eine falsche Richtung abdriftet. Ergänze Aspekte, die fehlen. Streiche, was offensichtlich irrelevant ist. Diese dreißig Sekunden Aufmerksamkeit können den Unterschied zwischen einem brauchbaren und einem mittelmäßigen Ergebnis ausmachen.

Prompt-Strategien, die nachweislich funktionieren

Unabhängig davon, ob du breit oder gezielt suchst, gibt es ein paar Techniken, die die Qualität der Ergebnisse konsistent verbessern. Hier sind sie mit konkreten Formulierungen, die du direkt in deinen nächsten Prompt übernehmen kannst.

Ziele statt Schritte. OpenAIs eigene Deep-Research-Forscher teilen eine kontraintuitive Erkenntnis: Statt dem System zu sagen, wie es suchen soll, beschreibe lieber, was du am Ende wissen willst. Das Modell kennt seine eigenen Stärken und Einschränkungen und findet oft effektivere Wege als du vorgeben könntest. Also nicht »Durchsuche erst Google Scholar, dann Reddit, dann …«, sondern: »Ich brauche einen Überblick über X, der mir hilft, Entscheidung Y zu treffen.«

Quellen benennen, aber nicht einschränken. Statt einer strikten Vorgabe lenkst du die Aufmerksamkeit:

Suche besonders in Experten-Communities (Reddit, Hacker News), in wissenschaftlichen Datenbanken und in offiziellen Dokumentationen der Anbieter. Andere Quellen sind willkommen, wenn sie substanziell sind.Unsicherheiten einfordern. Die explizite Anweisung, Wissenslücken zu kennzeichnen, reduziert nachweislich die Fehlerrate. In Tests senkte allein diese Technik die Halluzinationsrate um rund 50 Prozent:

Kennzeichne Aussagen, bei denen die Datenlage dünn oder widersprüchlich ist. Sage explizit, wenn du etwas nicht sicher belegen kannst. »Nicht gefunden« ist eine akzeptable Antwort.Zeitliche Eingrenzung. Eine der wirksamsten Anti-Halluzinations-Techniken – in Studien reduzierte sie falsche Behauptungen um bis zu 89 Prozent:

Beschränke dich auf Quellen und Daten aus dem Zeitraum 2023 bis heute. Wenn du ältere Quellen heranziehst, kennzeichne sie mit dem Erscheinungsjahr.Spannen statt Exaktheit. Wenn es um Zahlen geht:

Verwende Spannen statt exakter Zahlen, wenn die Datenlage unsicher ist. Statt »Der Marktanteil beträgt 23,7 %« lieber »Der Marktanteil liegt nach verschiedenen Schätzungen zwischen 20 und 25 %«.Konflikte sichtbar machen. Diese Anweisung verhindert, dass das System Widersprüche glattbügelt:

Wenn Quellen sich widersprechen, löse den Widerspruch nicht auf, sondern stelle beide Positionen nebeneinander dar und nenne die jeweiligen Quellen.Keine Beispiel-Antworten mitgeben. Perplexity warnt ausdrücklich davor, sogenanntes Few-Shot-Prompting zu verwenden – also Beispiele im Prompt mitzuliefern. Der Grund: Das System beginnt dann, nach den Beispielen zu suchen, statt nach der eigentlichen Frage. Was bei normalen Chat-KIs die Qualität verbessert, schadet bei suchbasierten Deep-Research-Systemen.

Verschiedene Modelle für verschiedene Phasen. Ein fortgeschrittener Ansatz: Ein schnelles Modell für die Planung und das Brainstorming, Deep Research für die eigentliche Suche, und ein separates Modell, das den fertigen Bericht auf Schwachstellen prüft – eine Art Advocatus Diaboli.

Zwei Prompt-Vorlagen zum Sofort-Einsetzen

Die folgenden Vorlagen lassen sich an beliebige Themen anpassen. Sie funktionieren, weil sie dem System nicht nur eine Frage stellen, sondern ein prüfbares Ergebnisformat vorgeben.

Vorlage »Due Diligence«:

Analysiere [Thema/Unternehmen/Produkt] wie ein Analyst: Markt, Konkurrenz, Preismodelle, regulatorische Risiken, Red Flags, Szenarien. Führe für jede rote Flagge mindestens zwei unabhängige Quellen an. Gib am Ende eine Auditliste: Welche Zahlen und Behauptungen muss ich selbst im Originaldokument prüfen?Vorlage »Nadel im Heuhaufen«:

Durchsuche die beigefügten Dokumente und das Web nach [konkrete Behauptung oder Detail]. Ergebnis nur dann als »gefunden« markieren, wenn du die Stelle zitieren kannst – Snippet, Quelle, Datum. Wenn nicht gefunden: Gib die besten Kandidatenstellen und erkläre, warum sie nicht ausreichen.Das Entscheidende an beiden Vorlagen: Sie erlauben dem System explizit, »nicht gefunden« zu sagen. Studien zeigen, dass KI-Systeme sonst lieber raten als eine Antwort zu verweigern. Wer diese Erlaubnis im Prompt nicht gibt, bekommt mit hoher Wahrscheinlichkeit eine plausibel klingende, aber erfundene Antwort.

Quellen prüfen: Warum die eingebaute Prüfung nicht reicht

Deep Research durchsucht dutzende bis hunderte Quellen und vergleicht deren Aussagen. Das sieht nach eingebauter Qualitätskontrolle aus – und in gewissem Maße ist es das auch. Aber es gibt einen entscheidenden Haken: Das System neigt dazu, Widersprüche aufzulösen statt sie sichtbar zu machen. Es wählt die plausiblere Version, glättet Unstimmigkeiten zu einem kohärenten Bericht – und du merkst nicht, dass es eine andere Version gab.

Das Ergebnis liest sich überzeugend, mit Quellenangaben und allem Drum und Dran. Genau das macht es gefährlich. Eine Untersuchung des Tow Center for Digital Journalism an der Columbia University hat acht KI-Suchsysteme getestet und festgestellt, dass über 60 Prozent der Zitier-Antworten teilweise oder komplett falsch waren – falsche Artikel, fabrizierte URLs, falsche Zuordnungen. Besonders beunruhigend: Die Systeme zeigten dabei eine hohe Selbstsicherheit und signalisierten selten Unsicherheit.

Wie das konkret aussieht, zeigte der Analyst Gijs Verheijke an OpenAIs eigenem Marketing-Beispiel für Deep Research – einer Smartphone-Marktanalyse. Der generierte Bericht behauptete einen iOS-Marktanteil von 69 Prozent in Japan. Die vom System selbst zitierte Quelle nannte 59,7 Prozent. Und die autoritative Primärquelle zeigte das Gegenteil: 63 Prozent Android. Drei Zahlen, drei verschiedene Realitäten – und das in einem Showcase-Beispiel des Herstellers.

Ein weiteres Problem, das erst seit Kurzem sichtbar wird: KI-Systeme beginnen, KI-generierte Quellen zu zitieren. Der Fall »Grokipedia« – eine automatisch erzeugte Enzyklopädie, die von mehreren Chatbots als seriöse Quelle behandelt wurde – zeigt, wohin das führt. Wenn KI ihre eigenen Erzeugnisse als Beleg heranzieht, entsteht eine Feedback-Schleife, in der Fehler sich selbst bestätigen. Die Frage »Ist das überhaupt eine menschlich erstellte, verantwortete Quelle?« wird damit zur Standardprüfung bei jeder Deep Research.

Echte Triangulation funktioniert anders. Das Prinzip stammt aus der Vermessungstechnik: Man bestimmt einen Punkt, indem man ihn von mehreren unabhängigen Standorten aus anpeilt. Übertragen auf Recherche heißt das: Die Differenzen zwischen verschiedenen Quellen oder Systemen sind der interessante Teil – nicht die glattgebügelte Zusammenfassung.

Vier Spielarten sind in der Praxis relevant:

Daten-Triangulation: Verschiedene Datenquellen für denselben Sachverhalt heranziehen. Unternehmensangaben mit Medienberichten und Behördendokumenten abgleichen.

Methoden-Triangulation: Denselben Sachverhalt mit verschiedenen Ansätzen untersuchen. Quantitative Daten mit qualitativen Einschätzungen kombinieren.

Forscher-Triangulation: Dieselbe Frage an Claude, ChatGPT und Gemini stellen und die Ergebnisse vergleichen. Nicht weil die Übereinstimmung beweist, dass etwas stimmt – sondern weil die Abweichungen zeigen, wo du genauer hinschauen solltest.

Theorie-Triangulation: Dieselben Daten durch verschiedene theoretische Brillen betrachten. Ein Markttrend sieht aus ökonomischer Perspektive anders aus als aus soziologischer.

Das Drei-Stufen-Protokoll für die Prüfung

Nicht jede Aussage in einem Deep-Research-Bericht muss gleich gründlich geprüft werden. Ein pragmatisches Protokoll sieht so aus:

Schnellprüfung (2–5 Minuten): Klick auf die angegebenen Quellen-Links. Existiert die Quelle überhaupt? Passt der Titel zum behaupteten Inhalt? Dieser Schritt allein entlarvt einen überraschend großen Teil der Halluzinationen.

Detailprüfung (10–20 Minuten): Zentrale Zahlen, Statistiken und Kernaussagen mit unabhängigen Quellen abgleichen. Stimmt die Zahl wirklich, oder hat das System sie »kreativ gerundet«?

Expertenurteil: Bei allem, was in Entscheidungen einfließt – rechtliche, medizinische, finanzielle – ist die finale Prüfung durch einen Menschen mit Fachkenntnis nicht verhandelbar. KI sollte nie die letzte Instanz sein.

Die richtigen Einstiegspunkte finden

Jede Recherche ist nur so gut wie ihre Ausgangsbasis. Bevor du Deep Research startest, lohnt es sich, die richtigen Suchbegriffe zu identifizieren.

Google Autocomplete zeigt, welche Fragen echte Menschen zu einem Thema stellen. Die »People Also Ask«-Boxen liefern verwandte Fragestellungen, die du selbst vielleicht nicht bedacht hättest. Und eine Methode, die in akademischen Recherchen Gold wert ist: Zitationssuche. Nimm eine gute Quelle, die du bereits kennst, und verfolge deren Referenzen rückwärts zu den Ursprungsarbeiten oder vorwärts zu neueren Studien, die darauf aufbauen.

Ein weiterer Trick: Übersetze allgemeine Begriffe in Fachterminologie. Statt »Wahlrecht Frauen« suche nach »electoral system AND female representation«. Die Trefferqualität in akademischen Datenbanken steigt dadurch erheblich.

Wo Deep Research an Grenzen stößt

Die Modelle durchsuchen primär öffentlich zugängliche Webinhalte. Paywalled-Artikel, interne Datenbanken, unveröffentlichte Studien bleiben unsichtbar. Wer sich auf wissenschaftliche Literatur stützen will, kommt um spezialisierte Dienste wie Web of Science oder ProQuest nicht herum.

Außerdem neigen alle Modelle zu einem dreifachen Bias. Der erste ist ein »Autoritätsbias«: Sie bevorzugen häufig zitierte Quellen, was dazu führen kann, dass etablierte, aber möglicherweise veraltete Perspektiven verstärkt werden – sogenannte »Zombie-Theorien«, die in der Wissenschaft längst überholt sind, aber noch überall herumgeistern. Der zweite ist ein »Anglophone Bias«: Englischsprachige Open-Access-Quellen werden systematisch bevorzugt, relevante Arbeiten in anderen Sprachen gehen unter. Und der dritte ist ein »Freshness Bias«: Untersuchungen zeigen, dass ein Großteil der zitierten Quellen aus den letzten zwölf Monaten stammt. Ältere, aber grundlegende Arbeiten fallen durchs Raster – nicht weil sie irrelevant wären, sondern weil das System Aktualität mit Relevanz verwechselt.

Dazu kommt ein strukturelles Problem, das erst seit Kurzem sichtbar wird: Verschiedene KI-Systeme konstruieren bei derselben Frage unterschiedliche Realitäten, weil sie unterschiedliche Quelltypen bevorzugen. Zwei Deep-Research-Läufe zum selben Thema können zu gegensätzlichen Schlussfolgerungen kommen – nicht weil eines der Systeme »falsch liegt«, sondern weil sie verschiedene Ausschnitte der verfügbaren Information sehen.

Und schließlich: Deep Research ersetzt kein Fachwissen. Das System liefert ein Fundament, manchmal ein erstaunlich gutes. Aber die Einordnung, die kritische Bewertung und die strategischen Schlussfolgerungen bleiben menschliche Aufgaben.

Ein Punkt, der oft übersehen wird: Deep Research verstärkt den Bestätigungsfehler. Die Art, wie du deine Frage formulierst, beeinflusst die gesamte Recherchestrategie. Das System findet, wonach du fragst – und wenn es das nicht findet, erfindet es etwas Passendes. Eine Anthropic-Studie zeigte, dass KI-Modelle ihre Antworten an die vermuteten Ansichten des Nutzers anpassen, selbst auf Kosten der Genauigkeit.

Auch die Erwartungen sollten realistisch sein: In aktuellen Benchmarks erreichen die besten Deep-Research-Systeme bei fokussierten Forschungsfragen Genauigkeiten zwischen 60 und 80 Prozent. Bei umfassenden Literaturübersichten – wo es darum geht, alle relevanten Studien zu finden – bricht die Abdeckung drastisch ein: Recall-Werte liegen oft im einstelligen Prozentbereich. Das zeigt: Deep Research eignet sich hervorragend als Einstieg und Überblick, aber nicht als Ersatz für eine systematische Literaturrecherche.

Der Output ist Rohmaterial, nicht Endprodukt. Wer ihn als fertigen Bericht behandelt, macht einen Fehler. Wer ihn als Fundament nimmt, auf dem man aufbaut, bekommt ein Werkzeug, das die eigene Arbeit um Größenordnungen beschleunigt.

Worauf es am Ende ankommt

Deep Research ist ein mächtiges Werkzeug, das mit jeder Modellgeneration besser wird. Aber es verlangt etwas, das sich nicht automatisieren lässt: methodisches Denken. Wer breit startet und dann gezielt vertieft, seine Fragen mit Bedacht stellt und die Ergebnisse nicht für bare Münze nimmt, bekommt Analysen, die vor zwei Jahren noch undenkbar waren.

Der beste Tipp passt in einen Satz: Behandle Deep Research nicht wie eine Suchmaschine, sondern wie einen Forschungsassistenten – einen, der enormes Tempo vorlegt, aber dem du jedes wichtige Ergebnis noch einmal über die Schulter schauen solltest.

Quellen und Daten

- Gijs Verheijke: OpenAI’s Deep Research demonstrates that reasoning does not solve hallucinations (2025) – Detailanalyse von Fehlern im OpenAI-Showcase-Beispiel

- Tow Center for Digital Journalism, Columbia University: We Compared Eight AI Search Engines – Untersuchung der Zitiergenauigkeit von KI-Suchsystemen

- Sharma et al.: Towards Understanding Sycophancy in Language Models (Anthropic, 2023/2025) – Studie zur Anpassung von KI-Antworten an Nutzererwartungen

- AI Alignment Forum: How I Think About My Research Process – Explore-Understand-Distill-Workflow

- 12 Tested Techniques That Prevent ChatGPT and Claude Hallucinations (Reddit, r/ChatGPTPromptGenius) – Grundlage für die Anti-Halluzinations-Prozentwerte

- Comprehensive Guide to Perplexity AI Prompting (Reddit, r/OpenAI) – Warnung vor Few-Shot-Prompting bei RAG-Systemen

- Mastering AI-Powered Research: My Guide to Deep Research (Reddit, r/ChatGPTPro) – Multi-Step-Orchestrierung und Blueprint-Methode

- Evaluating AI Deep Research for OSINT-Based Missing Persons (Medium) – Vergleichstest von vier KI-Modellen an einem realen Vermisstenfall

- LiveResearchBench: A Live Benchmark for Deep Research (arXiv, 2025) – Benchmark-Ergebnisse zur Genauigkeit von Deep-Research-Systemen

- ReportBench: Evaluating Deep Research Agents via Academic Survey Tasks (arXiv, 2025) – Recall-Analyse bei Literaturübersichten