Die Versprechen klingen großartig. KI spart Stunden pro Woche, wenn nicht sogar pro Tag. Sie automatisiert lästige Routinearbeit, macht uns produktiver, kreativer und in allem schneller. So steht es in den Pressemitteilungen, so klingt es auf Konferenzen und bei X. Stimmt ja auch. Aber …

Die Realität sieht dann oft anders aus. Wie nutzen die Leute KI heute wirklich?

Inhaltsverzeichnis

Die Zahlen: Wer nutzt KI wirklich?

Etwa jeder sechste Mensch weltweit nutzt generative KI-Tools – für die Arbeit, zum Lernen oder privat. 16,3 % der Weltbevölkerung, Stand zweite Jahreshälfte 2025. Die Zahl steigt, aber langsamer als man denkt: plus 1,2 Prozentpunkte in sechs Monaten.

In den USA verwenden 45 % der Angestellten KI mindestens gelegentlich. Aber nur 10 % tun es täglich. Zwischen »habe ich mal ausprobiert« und »ist Teil meines Arbeitstags« liegt eine gewaltige Lücke.

Die geografischen Unterschiede sind enorm. In den Vereinigten Arabischen Emiraten liegt die Nutzungsrate bei 64 %, in Singapur bei 61 %. Im globalen Süden stagniert sie bei 14 %. Südkorea hat den stärksten Zuwachs – durch staatliche Förderprogramme und eigene Sprachmodelle auf Koreanisch. Wer die Sprache hat, hat die Nutzer. Wie die KI-Nutzung in Deutschland im Detail aussieht, ist ein eigenes Kapitel.

Der unendliche Arbeitstag

Hier wird es interessant. Denn die Art, wie KI genutzt wird, erzählt eine andere Geschichte als die Adoptionszahlen.

Microsofts Work Trend Index 2025 liefert eine ernüchternde Zahl: Ein durchschnittlicher Mitarbeiter empfängt 153 Nachrichten pro Werktag über Microsoft Teams. In manchen Regionen stieg die Nachrichtenflut um über 20 % im Vergleich zum Vorjahr. Dazu kommen E-Mails, Meetings, Slack, interne Portale.

Die Folge: KI wird defensiv eingesetzt. Nicht um Arbeit besser zu machen, sondern um in der Flut nicht unterzugehen. 42 % nutzen KI, um Informationen zusammenzufassen. 41 %, um Schreibblockaden zu überwinden oder Ideen zu generieren. Der Arbeitstag beginnt mit dem Sichten von KI-Zusammenfassungen der nächtlichen E-Mail-Flut und endet mit einem dritten Produktivitätspeak am späten Abend – weil tagsüber zwischen Meetings keine Zeit zum Arbeiten bleibt.

Das ist der »Infinite Workday«. KI als Rettungsring in einem System, das eigentlich repariert werden müsste. Nicht als Werkzeug für besseres Denken, sondern als Bewältigungsmechanismus.

Was die Leute tatsächlich mit KI machen

Die Nutzungsmuster unterscheiden sich je nach Plattform erheblich. Anthropic und OpenAI haben im September 2025 parallele Studien veröffentlicht – Fortune hat beide verglichen –, und das Bild ist eindeutig.

ChatGPT wird überwiegend privat genutzt. Über 70 % der Nutzung ist nicht arbeitsbedingt – Alltagsfragen, Schreibhilfe, Informationssuche, allgemeiner Rat. Nur 4,2 % der Nachrichten betreffen Programmierung. ChatGPT entwickelt sich zum digitalen Allzweck-Berater.

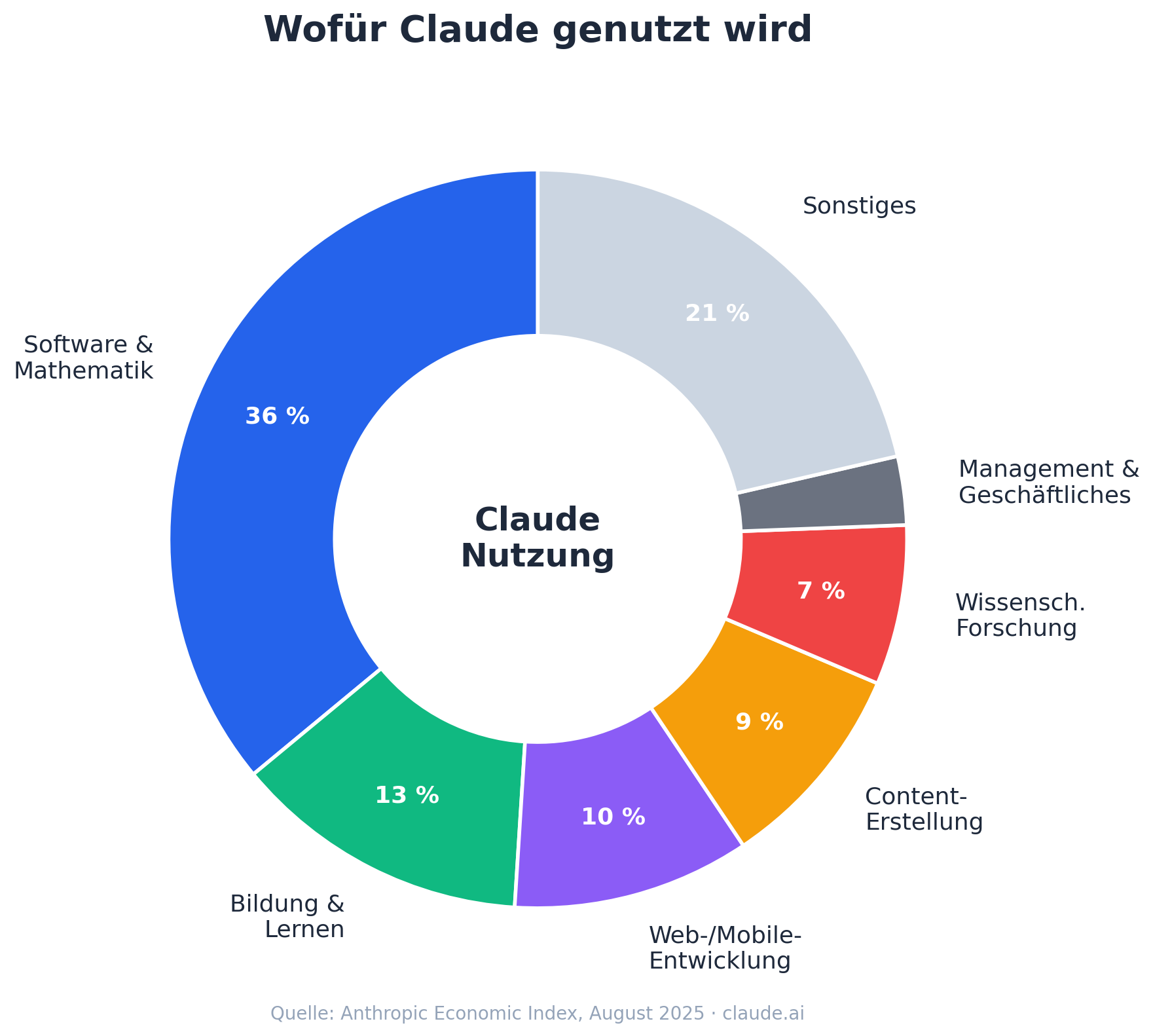

Claude ist das Gegenstück: ein Arbeitswerkzeug. 36 % der Nutzung entfällt auf Software-Entwicklung und mathematische Aufgaben. 13 % auf Bildung und Lernen, 10 % auf Web-Entwicklung, 9 % auf Content-Erstellung. Insgesamt sind 46 % der Nutzung arbeitsbedingt, 19 % studienbedingt. Bei der API – also der programmatischen Nutzung durch Unternehmen – liegt der Arbeitsanteil bei 74 %.

Besonders auffällig: Zum ersten Mal überwiegt bei Claude die Automatisierung gegenüber der Zusammenarbeit. 39 % der Gespräche sind inzwischen vollständige Aufgabendelegation – die KI erledigt den Job, der Mensch prüft das Ergebnis. Ende 2024 waren es noch 27 %.

Die Arbeitsteilung zwischen den Plattformen wird immer deutlicher. ChatGPT für den Alltag, Claude für die Arbeit, Gemini für die Google-Integration. Statt eines Alleskönners entstehen spezialisierte Werkzeuge.

Die Pilot-Hölle

88 % der Unternehmen setzen KI in mindestens einer Funktion ein. Das klingt beeindruckend. Weniger beeindruckend: Nur 39 % berichten über einen messbaren Einfluss auf das Betriebsergebnis.

Fast zwei Drittel der Organisationen haben es bisher nicht geschafft, KI-Projekte über isolierte Tests hinaus zu skalieren. Sie stecken in dem, was Berater die Pilot-Hölle nennen: Endlose Pilotprojekte, aber keine Umsetzung in der Breite.

Der Grund ist meistens nicht die Technologie. Es ist die fehlende Bereitschaft, bestehende Arbeitsabläufe grundlegend zu ändern. KI wird als Add-on auf veraltete Prozesse draufgesetzt, statt den Prozess neu zu denken. Das funktioniert ungefähr so gut, wie einen Elektromotor in eine Pferdekutsche zu bauen.

Dazu kommt die Datenqualität. Ein Großteil der gescheiterten KI-Projekte scheitert nicht an der Modellintelligenz, sondern an schlechten Daten. Schiefe Datensätze, inkonsistente Formate, Datensilos zwischen Abteilungen. Die beste KI der Welt liefert Unsinn, wenn man sie mit Müll füttert.

Shadow AI: Das Schattenproblem

Während Unternehmen an offiziellen KI-Strategien feilen, hat die Belegschaft längst Fakten geschaffen. Laut einer Branchenstudie von Reco AI nutzen 71 % der Büroangestellten KI-Tools ohne ausdrückliche Genehmigung der IT-Abteilung. Das Phänomen heißt Shadow AI und es ist kein Randproblem.

Was hochgeladen wird: Forschungsdaten (33 %), Mitarbeiterdaten wie Gehaltslisten (25 %), Finanzberichte (23 %). In Tools, deren Datensicherheitsstandards niemand geprüft hat. Die durchschnittlichen Kosten einer daraus resultierenden Datenverletzung: 670.000 Dollar.

Besonders brisant: Führungskräfte auf C-Level (69 %) sind deutlich eher bereit, Sicherheitsrisiken für höheres Arbeitstempo in Kauf zu nehmen als Junioren (38 %). Die Chefs gehen mit schlechtem Beispiel voran.

Über 53 % aller Shadow-AI-Aktivitäten entfallen auf OpenAI-Dienste. Das ist ein Klumpenrisiko: Sollte es dort zu einem Sicherheitsvorfall kommen, wären Zehntausende Unternehmen gleichzeitig betroffen.

Wer sich fragt, was mit den eigenen Daten passiert, wenn sie erst mal in der KI gelandet sind – die Antwort ist komplizierter als »einfach den Chat löschen«.

Lazy Thinking: Wenn KI das Denken ersetzt

Gartner prognostiziert, dass bis Ende 2026 die Hälfte aller globalen Organisationen »KI-freie« Einstellungsassessments einführen wird. Der Grund: Die Atrophie kritischer Denkfähigkeiten durch übermäßigen KI-Einsatz.

Das klingt dramatisch. Ist es auch. In komplexen Entscheidungssituationen neigen Menschen dazu, den statistisch plausiblen, aber oft oberflächlichen Empfehlungen der KI zu folgen, anstatt selbst eine Kausalanalyse durchzuführen. Die KI liefert eine Antwort, die sich richtig anfühlt. Das genügt vielen.

Studien zeigen, dass aktuelle Reasoning-Modelle bei geringfügigen Variationen in Aufgabenstellungen einen vollständigen Genauigkeitskollaps erleiden können. Was bei der Standardformulierung funktioniert, versagt bei einer leichten Abwandlung. Für unkritische Aufgaben ist das kein Problem. Für strategische Entscheidungen kann es teuer werden.

Das bedeutet nicht, dass man KI nicht für komplexe Fragen nutzen sollte. Aber man sollte sie als Sparringspartner behandeln, nicht als Orakel. Wer die richtigen Fragen stellt, bekommt bessere Antworten – und bleibt dabei im Denken.

Was man daraus lernen kann

Die Daten zeigen ein paar Dinge ziemlich klar.

KI wird von den meisten Menschen defensiv genutzt – zum Zusammenfassen, Sortieren, Bewältigen. Das ist nicht falsch, aber es ist auch nicht das, wofür die Technologie gebaut wurde. Wer sie nur als bessere Suchmaschine oder Zusammenfassungsmaschine einsetzt, verschenkt das meiste Potenzial.

Die Werkzeuge spezialisieren sich. ChatGPT für Alltagsfragen und Texte, Claude für Code und Recherche, Gemini für alles im Google-Ökosystem, Copilot für Office. Wer nur ein Tool kennt, kennt nur einen Ausschnitt.

Das größte Risiko ist nicht die KI selbst, sondern der sorglose Umgang mit ihr. Shadow AI, sensible Daten in ungeprüften Tools, Denkfaulheit bei wichtigen Entscheidungen. Das sind keine abstrakten Warnungen, das passiert gerade flächendeckend.

Und die wichtigste Erkenntnis, die in keiner Statistik steht: KI macht nicht automatisch besser. Sie macht schneller. Was man mit der gewonnenen Zeit anfängt – ob man sie für besseres Denken nutzt oder für mehr vom Gleichen – das entscheidet am Ende über den tatsächlichen Nutzen.

Quellen und Daten

Die Zahlen in diesem Artikel stammen aus folgenden Primärquellen:

- Global AI Adoption in 2025 – Microsoft AI Economy Institute. Globale Adoptionsraten, Ländervergleiche, Nutzungsfrequenzen.

- Work Trend Index 2025: Breaking Down the Infinite Workday – Microsoft. 153 Teams-Nachrichten pro Tag, Triple Peak Day, defensive KI-Nutzung.

- AI Use at Work Rises – Gallup. 45 % gelegentliche Nutzung, 10 % tägliche Nutzung unter US-Angestellten.

- The Anthropic Economic Index: Geography and Enterprise – Anthropic. Claude-Nutzungsmuster, Automatisierung vs. Zusammenarbeit, Branchenverteilung.

- How People Are Using ChatGPT – OpenAI. ChatGPT-Nutzungsmuster, 70 % private Nutzung, Aufgabenverteilung.

- The State of AI in 2025 – McKinsey. 88 % Unternehmensadoption, 39 % mit messbarem EBIT-Einfluss, Skalierungsprobleme.

- Strategic Predictions for 2026 – Gartner. Prognose zu KI-freien Einstellungsassessments, Atrophie kritischer Denkfähigkeiten.

- State of Shadow AI Report 2025 – Reco AI. Shadow-AI-Statistiken, 71 % unautorisierte Nutzung. (Hinweis: Reco ist Anbieter von Shadow-AI-Erkennung; die Zahlen stammen aus einer Branchenstudie des Unternehmens.)